- AnatomyEdit

- Voie ventrale auditiveModifier

- Reconnaissance des sonsModifier

- Compréhension des phrasesEdit

- BilatéralitéEdit

- Courant dorsal auditifModification

- Production de la paroleModifier

- Mimétisme vocal

- Surveillance de la paroleModifier

- Intégration des phonèmes avec les mouvements des lèvresEdit

- Mémoire phonologique à long termeEdit

- Mémoire de travail phonologiqueEdit

AnatomyEdit

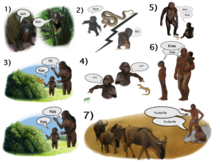

Au cours des deux dernières décennies, des avancées significatives ont eu lieu dans notre compréhension du traitement neuronal des sons chez les primates. Initialement par l’enregistrement de l’activité neuronale dans les cortex auditifs des singes, puis élaborés par des études de coloration histologique et de balayage IRMf, 3 champs auditifs ont été identifiés dans le cortex auditif primaire, et 9 champs auditifs associatifs ont été montrés pour les entourer (Figure 1 en haut à gauche). Les études de traçage anatomique et de lésion ont également indiqué une séparation entre les champs auditifs antérieurs et postérieurs, les champs auditifs primaires antérieurs (zones R-RT) se projetant sur les champs auditifs associatifs antérieurs (zones AL-RTL), et le champ auditif primaire postérieur (zone A1) se projetant sur les champs auditifs associatifs postérieurs (zones CL-CM). Récemment, des preuves se sont accumulées qui indiquent une homologie entre les champs auditifs de l’homme et du singe. Chez l’homme, des études de coloration histologique ont révélé l’existence de deux champs auditifs distincts dans la région auditive primaire du gyrus de Heschl, et en cartographiant l’organisation tonotopique des champs auditifs primaires humains par IRMf à haute résolution et en la comparant à l’organisation tonotopique des champs auditifs primaires du singe, une homologie a été établie entre le champ auditif primaire antérieur humain et l’aire R du singe (appelée aire hR chez l’homme) et le champ auditif primaire postérieur humain et l’aire A1 du singe (appelée aire hA1 chez l’homme). Les enregistrements intra-corticaux du cortex auditif humain ont également montré des schémas de connectivité similaires à ceux du cortex auditif du singe. L’enregistrement de la surface du cortex auditif (plan supra-temporal) a révélé que le gyrus de Heschl antérieur (zone hR) se projette principalement vers le gyrus temporal supérieur moyen-antérieur (mSTG-aSTG) et que le gyrus de Heschl postérieur (zone hA1) se projette principalement vers le gyrus temporal supérieur postérieur (pSTG) et le planum temporale (zone PT ; figure 1, en haut à droite). L’étude par IRMf d’un patient souffrant de troubles de la reconnaissance des sons (agnosie auditive) confirme l’existence de connexions entre l’aire hR et l’aSTG et entre l’aire hA1 et le pSTG : l’activation bilatérale des aires hR et aSTG est réduite, mais l’activation de l’aire mSTG-pSTG est épargnée. Ce schéma de connectivité est également corroboré par une étude qui a enregistré l’activation de la surface latérale du cortex auditif et a rapporté des grappes d’activation simultanées non chevauchantes dans le pSTG et le mSTG-aSTG pendant l’écoute de sons.

En aval du cortex auditif, des études de traçage anatomique chez le singe ont délimité des projections des champs auditifs associatifs antérieurs (zones AL-RTL) vers les cortex préfrontal et prémoteur ventraux dans le gyrus frontal inférieur (IFG) et l’amygdale. Des études d’enregistrement cortical et d’imagerie fonctionnelle chez le singe macaque ont approfondi ce flux de traitement en montrant que l’information acoustique circule du cortex auditif antérieur vers le pôle temporal (TP) puis vers l’IFG. Cette voie est communément appelée le courant ventral auditif (AVS ; figure 1, flèches rouges en bas à gauche). Contrairement aux champs auditifs antérieurs, les études de traçage indiquent que les champs auditifs postérieurs (zones CL-CM) se projettent principalement vers les cortex préfrontal et prémoteur dorsolatéraux (bien que certaines projections se terminent dans l’IFG). Des enregistrements corticaux et des études de traçage anatomique chez le singe ont fourni des preuves supplémentaires que ce flux de traitement passe des champs auditifs postérieurs au lobe frontal via une station relais dans le sillon intra-pariétal (IPS). Cette voie est communément appelée le courant auditif dorsal (ADS ; figure 1, flèches bleues en bas à gauche). La comparaison des voies de la substance blanche impliquées dans la communication chez l’homme et le singe avec des techniques d’imagerie du tenseur de diffusion indique des connexions similaires de l’AVS et de l’ADS chez les deux espèces (singe, homme). Chez l’homme, il a été démontré que le GSTP se projette vers le lobe pariétal (jonction sylvienne pariétale-temporale-lobe pariétal inférieur ; Spt-IPL) et, de là, aux cortex préfrontal et prémoteur dorsolatéraux (figure 1, flèches bleues en bas à droite), et il a été montré que l’aSTG se projette vers le lobe temporal antérieur (gyrus temporal moyen-pôle temporal ; MTG-TP) et, de là, vers l’IFG (figure 1, flèches rouges en bas à droite).

Voie ventrale auditiveModifier

La voie ventrale auditive (AVS) relie le cortex auditif au gyrus temporal moyen et au pôle temporal, qui lui-même est relié au gyrus frontal inférieur. Cette voie est responsable de la reconnaissance des sons, et est donc connue sous le nom de voie du « quoi » auditif. Les fonctions de l’AVS sont notamment les suivantes.

Reconnaissance des sonsModifier

Des preuves convergentes cumulatives indiquent que l’AVS est impliquée dans la reconnaissance des objets auditifs. Au niveau du cortex auditif primaire, des enregistrements chez le singe ont montré un pourcentage plus élevé de neurones sélectifs des séquences mélodiques apprises dans l’aire R que dans l’aire A1, et une étude chez l’homme a démontré une plus grande sélectivité des syllabes entendues dans le gyrus de Heschl antérieur (aire hR) que dans le gyrus de Heschl postérieur (aire hA1). Dans les champs auditifs associatifs en aval, des études menées à la fois chez le singe et chez l’homme ont rapporté que la frontière entre les champs auditifs antérieurs et postérieurs (figure 1 – zone PC chez le singe et mSTG chez l’homme) traite les attributs de hauteur de son qui sont nécessaires à la reconnaissance des objets auditifs. Les enregistrements intra-corticaux ont également démontré que les champs auditifs antérieurs des singes sont sélectifs pour les vocalisations spécifiques au cône. et l’imagerie fonctionnelle Une étude par IRMf chez le singe a également démontré le rôle du GTSA dans la reconnaissance des voix individuelles. Le rôle du mSTG-aSTG humain dans la reconnaissance des sons a été démontré par des études d’imagerie fonctionnelle qui ont corrélé l’activité de cette région avec l’isolation des objets auditifs du bruit de fond, et avec la reconnaissance des mots parlés, des voix, des mélodies, des sons environnementaux et des sons de communication non vocaux. Une méta-analyse des études d’IRMf a en outre démontré une dissociation fonctionnelle entre la mSTG et l’aSTG gauches, la première traitant les unités de parole courtes (phonèmes) et la seconde les unités plus longues (par exemple, mots, sons environnementaux). Une étude qui a enregistré l’activité neuronale directement à partir du pSTG et de l’aSTG gauches a montré que l’aSTG, mais pas le pSTG, était plus actif lorsque le patient écoutait des paroles dans sa langue maternelle que dans une langue étrangère non familière. De manière cohérente, l’électrostimulation de l’aSTG de cette patiente a entraîné une altération de la perception de la parole (voir également pour des résultats similaires). Des enregistrements intra-corticaux de l’aSTG droit et gauche ont également démontré que la parole est traitée latéralement à la musique. Une étude par IRMf d’un patient souffrant de troubles de la reconnaissance des sons (agnosie auditive) dus à une lésion du tronc cérébral a également montré une activation réduite dans les zones hR et aSTG des deux hémisphères lors de l’audition de mots parlés et de sons environnementaux. Les enregistrements du cortex auditif antérieur des singes lors du maintien des sons appris dans la mémoire de travail, et l’effet débilitant des lésions induites dans cette région sur le rappel de la mémoire de travail, impliquent également l’AVS dans le maintien des objets auditifs perçus dans la mémoire de travail. Chez l’homme, l’activité de l’aire mSTG-aSTG a également été signalée pendant la répétition de syllabes entendues par MEG et IRMf. Cette dernière étude a également démontré que la mémoire de travail de l’AVS concerne les propriétés acoustiques des mots parlés et qu’elle est indépendante de la mémoire de travail de l’ADS, qui gère la parole intérieure. Les études sur la mémoire de travail chez les singes suggèrent également que chez les singes, contrairement aux humains, l’AVS est le magasin de mémoire de travail dominant.

Chez les humains, en aval de l’aSTG, le MTG et le TP sont censés constituer le lexique sémantique, qui est un dépôt de mémoire à long terme de représentations audio-visuelles qui sont interconnectées sur la base de relations sémantiques. (Voir également les revues qui traitent de ce sujet). La principale preuve de ce rôle de la MTG-TP est que les patients présentant des lésions dans cette région (par exemple, les patients atteints de démence sémantique ou d’encéphalite à virus herpès simplex) ont une capacité réduite à décrire des objets visuels et auditifs et une tendance à commettre des erreurs sémantiques lorsqu’ils nomment des objets (c’est-à-dire une paraphasie sémantique). Des paraphasies sémantiques ont également été exprimées par des patients aphasiques présentant des lésions du MTG-TP gauche et il a été démontré qu’elles se produisaient chez des patients non aphasiques après une électrostimulation de cette région. ou la voie de la substance blanche sous-jacente Deux méta-analyses de la littérature en IRMf ont également rapporté que le MTG et le TP antérieurs étaient constamment actifs pendant l’analyse sémantique de la parole et du texte ; et une étude d’enregistrement intra-cortical a corrélé la décharge neuronale dans le MTG avec la compréhension de phrases intelligibles.

Compréhension des phrasesEdit

En plus d’extraire le sens des sons, la région MTG-TP de l’AVS semble avoir un rôle dans la compréhension des phrases, peut-être en fusionnant les concepts entre eux (ex, en fusionnant le concept « bleu » et « chemise » pour créer le concept de « chemise bleue »). Le rôle du MTG dans l’extraction du sens des phrases a été démontré par des études d’imagerie fonctionnelle qui ont rapporté une activation plus forte dans le MTG antérieur lorsque des phrases correctes sont comparées à des listes de mots, des phrases dans une langue étrangère ou absurde, des phrases brouillées, des phrases avec des violations sémantiques ou syntaxiques et des séquences de sons environnementaux semblables à des phrases. Une étude d’IRMf dans laquelle les participants devaient lire une histoire a permis de corréler l’activité dans le MTG antérieur avec la quantité de contenu sémantique et syntaxique de chaque phrase. Une étude EEG qui a comparé l’activité corticale lors de la lecture de phrases avec et sans violations syntaxiques chez des participants sains et des patients présentant des lésions du MTG-TP, a conclu que le MTG-TP des deux hémisphères participe à l’étape automatique (basée sur des règles) de l’analyse syntaxique (composante ELAN), et que le MTG-TP gauche est également impliqué dans une étape ultérieure contrôlée de l’analyse syntaxique (composante P600). Des patients présentant des lésions de la région MTG-TP ont également été signalés comme présentant des troubles de la compréhension des phrases. Voir la revue pour plus d’informations sur ce sujet.

BilatéralitéEdit

En contradiction avec le modèle de Wernicke-Lichtheim-Geschwind qui implique que la reconnaissance des sons se produit uniquement dans l’hémisphère gauche, des études qui ont examiné les propriétés de l’hémisphère droit ou gauche de manière isolée via une anesthésie hémisphérique unilatérale (c’est-à-dire la procédure AMA) ou des enregistrements intra-corticaux de chaque hémisphère ont fourni des preuves que la reconnaissance des sons est traitée de manière bilatérale. De plus, une étude dans laquelle on a demandé à des patients dont les hémisphères étaient déconnectés (c’est-à-dire des patients au cerveau divisé) de faire correspondre des mots parlés à des mots écrits présentés dans l’hémisphère droit ou gauche, a révélé que le vocabulaire de l’hémisphère droit était presque aussi étendu que celui de l’hémisphère gauche (le vocabulaire de l’hémisphère droit était équivalent à celui d’un enfant sain de 11 ans). Cette reconnaissance bilatérale des sons est également cohérente avec le fait qu’une lésion unilatérale du cortex auditif entraîne rarement un déficit de la compréhension auditive (c’est-à-dire une agnosie auditive), alors qu’une seconde lésion de l’hémisphère restant (qui peut survenir des années plus tard) le fait. Enfin, comme mentionné précédemment, une IRMf d’un patient atteint d’agnosie auditive a démontré une activation réduite bilatérale dans les cortex auditifs antérieurs, et l’électrostimulation bilatérale de ces régions dans les deux hémisphères a entraîné une altération de la reconnaissance de la parole.

Courant dorsal auditifModification

Le courant dorsal auditif relie le cortex auditif au lobe pariétal, qui à son tour est relié au gyrus frontal inférieur. Chez les humains comme chez les primates non humains, le flux auditif dorsal est responsable de la localisation des sons, et est donc connu sous le nom de voie auditive « où ». Chez l’homme, cette voie (surtout dans l’hémisphère gauche) est également responsable de la production de la parole, de la répétition de la parole, de la lecture sur les lèvres, ainsi que de la mémoire de travail phonologique et de la mémoire à long terme.

Production de la paroleModifier

Des études sur des humains actuels ont démontré un rôle de l’ADS dans la production de la parole, notamment dans l’expression vocale des noms d’objets. Par exemple, dans une série d’études dans lesquelles les fibres sous-corticales ont été directement stimulées, l’interférence dans le pSTG et l’IPL gauche a entraîné des erreurs pendant les tâches de dénomination d’objets, et l’interférence dans l’IFG gauche a entraîné l’arrêt de la parole. Une étude a également rapporté que la stimulation électrique de l’IPL gauche faisait croire à des patients qu’ils avaient parlé alors que ce n’était pas le cas et que la stimulation de l’IFG faisait bouger inconsciemment les lèvres des patients. La contribution de l’ADS au processus d’articulation du nom des objets pourrait dépendre de la réception d’afférences provenant du lexique sémantique de l’AVS, En effet, une étude d’enregistrement intra-cortical a rapporté une activation dans le MTG postérieur avant l’activation dans la région Spt-IPL lorsque des patients nommaient des objets dans des images. Des études de stimulation électrique intra-corticale ont également rapporté que l’interférence électrique dans le MTG postérieur était corrélée à une altération de la dénomination des objets

Mimétisme vocal

Bien que la perception des sons soit principalement attribuée à l’AVS, l’ADS semble associé à plusieurs aspects de la perception de la parole. Par exemple, dans une méta-analyse d’études d’IRMf (Turkeltaub et Coslett, 2010), dans laquelle la perception auditive de phonèmes a été mise en contraste avec des sons étroitement appariés, et les études ont été évaluées pour le niveau d’attention requis, les auteurs ont conclu que l’attention aux phonèmes est corrélée à une forte activation dans la région pSTG-pSTS. Une étude d’enregistrement intra-cortical dans laquelle les participants devaient identifier des syllabes a également corrélé l’audition de chaque syllabe avec son propre schéma d’activation dans le pSTG. L’implication de l’ADS dans la perception et la production de la parole a été mise en lumière par plusieurs études pionnières d’imagerie fonctionnelle qui ont mis en contraste la perception de la parole avec la production de parole manifeste ou secrète. Ces études ont démontré que le STSP n’est actif que pendant la perception de la parole, alors que l’aire Spt est active à la fois pendant la perception et la production de la parole. Les auteurs ont conclu que le STSP projette vers l’aire Spt, qui convertit l’entrée auditive en mouvements articulatoires. Des résultats similaires ont été obtenus dans une étude dans laquelle les lobes temporaux et pariétaux des participants ont été stimulés électriquement. Cette étude rapporte que la stimulation électrique de la région pSTG interfère avec la compréhension des phrases et que la stimulation de l’IPL interfère avec la capacité à vocaliser le nom des objets. Les auteurs ont également rapporté que la stimulation de l’aire Spt et de l’IPL inférieur induisait une interférence lors des tâches de dénomination d’objets et de compréhension de la parole. Le rôle de l’ADS dans la répétition de la parole est également conforme aux résultats d’autres études d’imagerie fonctionnelle qui ont localisé l’activation pendant les tâches de répétition de la parole dans les régions de l’ADS. Une étude d’enregistrement intra-cortical qui a enregistré l’activité dans la plupart des lobes temporaux, pariétaux et frontaux a également signalé une activation dans le pSTG, le Spt, l’IPL et l’IFG lorsque la répétition de la parole est mise en contraste avec la perception de la parole. Des études neuropsychologiques ont également révélé que les personnes présentant des déficits de répétition de la parole mais une compréhension auditive préservée (c’est-à-dire une aphasie de conduction) souffrent de dommages circonscrits à la zone Spt-IPL ou de dommages aux projections qui émanent de cette zone et ciblent le lobe frontal. Des études ont également signalé un déficit transitoire de répétition de la parole chez les patients après une stimulation électrique intra-corticale directe de cette même région. Un aperçu de l’objectif de la répétition de la parole dans l’ADS est fourni par des études longitudinales d’enfants qui ont corrélé l’apprentissage d’un vocabulaire étranger avec la capacité de répéter des mots sans sens.

Surveillance de la paroleModifier

En plus de répéter et de produire la parole, l’ADS semble avoir un rôle dans la surveillance de la qualité de la sortie de la parole. Des preuves neuroanatomiques suggèrent que l’ADS est équipé de connexions descendantes de l’IFG vers le pSTG qui relaient des informations sur l’activité motrice (c’est-à-dire les décharges corollaires) dans l’appareil vocal (bouche, langue, plis vocaux). Ce feedback marque le son perçu pendant la production de la parole comme étant autoproduit et peut être utilisé pour ajuster l’appareil vocal afin d’augmenter la similarité entre les cris perçus et émis. Des preuves de l’existence de connexions descendantes entre l’IFG et le pSTG ont été fournies par une étude qui a stimulé électriquement l’IFG pendant des opérations chirurgicales et a rapporté la propagation de l’activation à la région pSTG-pSTS-Spt Une étude qui a comparé la capacité de patients aphasiques avec un lobe frontal, Une étude comparant la capacité de patients aphasiques présentant des lésions du lobe frontal, pariétal ou temporal à articuler rapidement et de manière répétée une chaîne de syllabes a montré que les lésions du lobe frontal interféraient avec l’articulation de chaînes syllabiques identiques (« Bababa ») et de chaînes syllabiques non identiques (« Badaga »), tandis que les patients présentant des lésions du lobe temporal ou pariétal ne présentaient une déficience que lors de l’articulation de chaînes syllabiques non identiques. Étant donné que les patients souffrant de lésions des lobes temporal et pariétal étaient capables de répéter la chaîne syllabique dans la première tâche, leur perception et leur production de la parole semblent être relativement préservées, et leur déficit dans la deuxième tâche est donc dû à une altération du contrôle. Démontrant le rôle des connexions ADS descendantes dans la surveillance des appels émis, une étude IRMf a demandé aux participants de parler dans des conditions normales ou en entendant une version modifiée de leur propre voix (premier formant retardé) et a rapporté que l’audition d’une version déformée de sa propre voix entraîne une activation accrue dans le pSTG. Une étude d’enregistrement intra-cortical qui a mis en contraste la perception et la répétition de la parole démontre également que l’ADS facilite le retour moteur pendant le mimétisme. Les auteurs ont rapporté que, en plus de l’activation dans l’IPL et l’IFG, la répétition de la parole est caractérisée par une activation plus forte dans le pSTG que pendant la perception de la parole.

Intégration des phonèmes avec les mouvements des lèvresEdit

Bien que la perception des sons soit principalement attribuée à l’AVS, l’ADS semble associé à plusieurs aspects de la perception de la parole. Par exemple, dans une méta-analyse d’études d’IRMf dans lesquelles la perception auditive de phonèmes était contrastée avec des sons étroitement appariés, et les études étaient évaluées pour le niveau d’attention requis, les auteurs ont conclu que l’attention aux phonèmes est corrélée à une forte activation dans la région pSTG-pSTS. Une étude d’enregistrement intra-cortical dans laquelle les participants devaient identifier des syllabes a également corrélé l’audition de chaque syllabe avec son propre schéma d’activation dans le pSTG. En accord avec le rôle de l’ADS dans la discrimination des phonèmes, des études ont attribué l’intégration des phonèmes et des mouvements correspondants des lèvres (c’est-à-dire des visèmes) à la région pSTS de l’ADS. Par exemple, une étude d’IRMf a établi une corrélation entre l’activation du STSP et l’illusion de McGurk (dans laquelle le fait d’entendre la syllabe « ba » tout en voyant le visème « ga » entraîne la perception de la syllabe « da »). Une autre étude a montré que l’utilisation de la stimulation magnétique pour interférer avec le traitement dans cette zone perturbe davantage l’illusion de McGurk. L’association du SSPT avec l’intégration audiovisuelle de la parole a également été démontrée dans une étude qui présentait aux participants des images de visages et des mots parlés de qualité variable. L’étude a révélé que le STSP sélectionne l’augmentation combinée de la clarté des visages et des mots prononcés. Des preuves corroborantes ont été fournies par une étude d’IRMf qui a mis en contraste la perception de la parole audiovisuelle avec la non-parole audiovisuelle (images et sons d’outils). Cette étude a révélé la détection de compartiments sélectifs de la parole dans le SSPT. En outre, une étude d’IRMf qui a opposé la parole audiovisuelle congruente à la parole incongrue (images de visages immobiles) a fait état d’une activation du STSP. Pour une revue présentant des preuves convergentes supplémentaires concernant le rôle du pSTS et de l’ADS dans l’intégration phonème-viséme, voir.

Mémoire phonologique à long termeEdit

Un nombre croissant de preuves indique que les humains, en plus d’avoir un stockage à long terme pour les significations des mots situés dans le MTG-TP de l’AVS (c’est-à-dire, le lexique sémantique), ils disposent également d’une mémoire à long terme pour les noms d’objets situés dans la région Spt-IPL de l’ADS (c’est-à-dire le lexique phonologique). Par exemple, une étude portant sur des patients présentant des lésions de l’AVS (lésions du MTG) ou de l’ADS (lésions de l’IPL) a montré que les lésions du MTG entraînent une identification incorrecte des objets (par exemple, appeler une » chèvre » un » mouton « , un exemple de paraphasie sémantique). À l’inverse, les lésions de l’IPL entraînent une identification correcte de l’objet mais une prononciation incorrecte de son nom (par exemple, dire » gof » au lieu de » goat « , un exemple de paraphasie phonémique). Des erreurs de paraphasie sémantique ont également été rapportées chez des patients recevant une stimulation électrique intra-corticale de l’AVS (MTG), et des erreurs de paraphasie phonémique ont été rapportées chez des patients dont l’ADS (pSTG, Spt et IPL) a reçu une stimulation électrique intra-corticale. Une étude MEG qui a localisé l’activité dans l’IPL pendant l’apprentissage et le rappel des noms d’objets confirme le rôle de l’ADS dans la dénomination des objets. Une étude qui a induit une interférence magnétique dans l’IPL des participants pendant qu’ils répondaient à des questions sur un objet a montré que les participants étaient capables de répondre à des questions concernant les caractéristiques ou les attributs perceptifs de l’objet, mais qu’ils avaient des difficultés lorsqu’on leur demandait si le mot contenait deux ou trois syllabes. Une étude MEG a également établi une corrélation entre la récupération de l’anomie (un trouble caractérisé par une altération de la capacité à nommer les objets) et des changements dans l’activation de l’IPL. Les études qui rapportent que, par rapport aux monolingues, les bilingues ont une plus grande densité corticale dans l’IPL, mais pas dans le MTG, confirment le rôle de l’IPL dans l’encodage des sons des mots. Puisque les preuves montrent que, chez les bilingues, différentes représentations phonologiques du même mot partagent la même représentation sémantique, cette augmentation de la densité dans l’IPL vérifie l’existence du lexique phonologique : le lexique sémantique des bilingues devrait être de taille similaire au lexique sémantique des monolingues, alors que leur lexique phonologique devrait être deux fois plus grand. Conformément à cette constatation, la densité corticale dans l’IPL des monolingues est également corrélée à la taille du vocabulaire. Notamment, la dissociation fonctionnelle de l’AVS et de l’ADS dans les tâches de dénomination d’objets est soutenue par des preuves cumulatives issues de la recherche sur la lecture, montrant que les erreurs sémantiques sont corrélées à une déficience du MTG et les erreurs phonémiques à une déficience de l’IPL. Sur la base de ces associations, l’analyse sémantique du texte a été liée au gyrus inféro-temporal et au MTG, et l’analyse phonologique du texte a été liée au pSTG-Spt- IPL

Mémoire de travail phonologiqueEdit

La mémoire de travail est souvent traitée comme l’activation temporaire des représentations stockées en mémoire à long terme qui sont utilisées pour la parole (représentations phonologiques). Ce partage des ressources entre la mémoire de travail et la parole est mis en évidence par la constatation que parler pendant la répétition entraîne une réduction significative du nombre d’éléments qui peuvent être rappelés de la mémoire de travail (suppression articulatoire). L’implication du lexique phonologique dans la mémoire de travail est également mise en évidence par la tendance des individus à commettre plus d’erreurs lorsqu’ils rappellent des mots d’une liste de mots phonologiquement similaires récemment appris que d’une liste de mots phonologiquement dissemblables (effet de similarité phonologique). Des études ont également montré que les erreurs de prononciation commises pendant la lecture sont remarquablement similaires aux erreurs de prononciation commises pendant le rappel de mots récemment appris et phonologiquement similaires dans la mémoire de travail. Enfin, le point de vue selon lequel la mémoire de travail verbale est le résultat de l’activation temporaire des représentations phonologiques dans le SDA est compatible avec les modèles récents décrivant la mémoire de travail comme la combinaison du maintien des représentations dans le mécanisme d’attention en parallèle avec l’activation temporaire des représentations dans la mémoire à long terme. Il a été avancé que le rôle de l’ADS dans la répétition de listes de mots est la raison pour laquelle cette voie est active pendant la compréhension des phrases Pour une revue du rôle de l’ADS dans la mémoire de travail, voir.

.