- AnatomyEdit

- Corriente ventral auditivaEditar

- Reconocimiento de sonidosEditar

- Comprensión de oracionesEditar

- BilateralidadEditar

- Corriente dorsal auditivaEditar

- Producción del hablaEditar

- Imitación vocalEditar

- Monitorización del hablaEditar

- Integración de los fonemas con los movimientos de los labiosEditar

- Memoria fonológica a largo plazoEditar

- Memoria de trabajo fonológicaEditar

AnatomyEdit

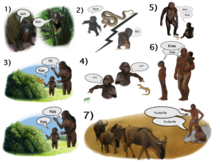

En las dos últimas décadas, se produjeron avances significativos en nuestra comprensión del procesamiento neural de los sonidos en los primates. Inicialmente mediante el registro de la actividad neural en las cortezas auditivas de los monos y posteriormente elaborado a través de tinciones histológicas y estudios de escaneo fMRI, se identificaron 3 campos auditivos en la corteza auditiva primaria, y se demostró que 9 campos auditivos asociativos los rodeaban (Figura 1 superior izquierda). Los estudios de trazado anatómico y de lesiones indicaron además una separación entre los campos auditivos anteriores y posteriores, con los campos auditivos primarios anteriores (áreas R-RT) proyectando a los campos auditivos asociativos anteriores (áreas AL-RTL), y el campo auditivo primario posterior (área A1) proyectando a los campos auditivos asociativos posteriores (áreas CL-CM). Recientemente, se han acumulado pruebas que indican una homología entre los campos auditivos del ser humano y del mono. En los seres humanos, los estudios de tinción histológica revelaron dos campos auditivos separados en la región auditiva primaria de la circunvolución de Heschl, y mediante el mapeo de la organización tonotópica de los campos auditivos primarios humanos con fMRI de alta resolución y su comparación con la organización tonotópica de los campos auditivos primarios de los monos, se estableció una homología entre el campo auditivo primario anterior humano y el área R de los monos (denotada en los seres humanos como área hR) y el campo auditivo primario posterior humano y el área A1 de los monos (denotada en los seres humanos como área hA1). Las grabaciones intracorticales de la corteza auditiva humana demostraron además patrones similares de conectividad con la corteza auditiva del mono. Los registros de la superficie de la corteza auditiva (plano supratemporal) indicaron que la circunvolución anterior de Heschl (área hR) se proyecta principalmente a la circunvolución temporal superior media-anterior (mSTG-aSTG) y la circunvolución posterior de Heschl (área hA1) se proyecta principalmente a la circunvolución temporal superior posterior (pSTG) y al planum temporale (área PT; Figura 1, arriba a la derecha). Un estudio de IRMf de un paciente con problemas de reconocimiento de sonidos (agnosia auditiva) es consistente con las conexiones del área hR con el aSTG y del hA1 con el pSTG. Este patrón de conectividad también es corroborado por un estudio que registró la activación de la superficie lateral de la corteza auditiva e informó de grupos de activación simultáneos no superpuestos en el pSTG y el mSTG-aSTG mientras se escuchaban sonidos.

Desde la corteza auditiva, los estudios de rastreo anatómico en monos delinearon proyecciones desde los campos auditivos asociativos anteriores (áreas AL-RTL) hasta las cortezas prefrontal y premotora ventrales en el giro frontal inferior (IFG) y la amígdala. Los estudios de grabación cortical e imagen funcional en monos macacos profundizaron en esta vía de procesamiento demostrando que la información acústica fluye desde el córtex auditivo anterior al polo temporal (TP) y luego al IFG. Esta vía se denomina comúnmente flujo auditivo ventral (AVS; Figura 1, abajo a la izquierda – flechas rojas). A diferencia de los campos auditivos anteriores, los estudios de rastreo indican que los campos auditivos posteriores (áreas CL-CM) se proyectan principalmente a las cortezas prefrontal y premotora dorsolaterales (aunque algunas proyecciones terminan en el IFG). Las grabaciones corticales y los estudios de trazado anatómico en monos proporcionaron además pruebas de que esta corriente de procesamiento fluye desde los campos auditivos posteriores hasta el lóbulo frontal a través de una estación de relevo en el surco intraparietal (IPS). Esta vía se denomina comúnmente flujo dorsal auditivo (ADS; Figura 1, flechas azules abajo a la izquierda). La comparación de las vías de materia blanca implicadas en la comunicación en humanos y monos con técnicas de imagen de tensor de difusión indica que las conexiones del AVS y el ADS son similares en las dos especies (mono, humano). En los humanos, se demostró que el pSTG se proyecta al lóbulo parietal (unión silvio-temporal-lóbulo parietal inferior; Spt-IPL), y de ahí a las cortezas prefrontal y premotora dorsolaterales (Figura 1, abajo a la derecha-flechas azules), y se demostró que el aSTG se proyectaba al lóbulo temporal anterior (giro temporal medio-polo temporal; MTG-TP) y de ahí al IFG (Figura 1 abajo a la derecha-flechas rojas).

Corriente ventral auditivaEditar

La corriente ventral auditiva (AVS) conecta la corteza auditiva con la circunvolución temporal media y el polo temporal, que a su vez conecta con la circunvolución frontal inferior. Esta vía es la responsable del reconocimiento del sonido, por lo que se conoce como la vía auditiva del «qué». Las funciones del SVA incluyen las siguientes.

Reconocimiento de sonidosEditar

La evidencia convergente acumulada indica que el SVA está involucrado en el reconocimiento de objetos auditivos. A nivel de la corteza auditiva primaria, las grabaciones realizadas en monos mostraron un mayor porcentaje de neuronas selectivas para las secuencias melódicas aprendidas en el área R que en el área A1, y un estudio realizado en humanos demostró una mayor selectividad para las sílabas escuchadas en la circunvolución anterior de Heschl (área hR) que en la posterior (área hA1). En los campos auditivos asociativos descendentes, los estudios realizados tanto en monos como en humanos informaron de que el límite entre los campos auditivos anteriores y posteriores (Figura 1, área PC en el mono y mSTG en el humano) procesa atributos de tono que son necesarios para el reconocimiento de objetos auditivos. Los campos auditivos anteriores de los monos también demostraron una selectividad para las vocalizaciones con-específicas con grabaciones intracorticales. e imágenes funcionales Un estudio de monos con fMRI demostró además un papel del aSTG en el reconocimiento de voces individuales. El papel del mSTG-aSTG humano en el reconocimiento de sonidos se demostró mediante estudios de imagen funcional que correlacionaban la actividad de esta región con el aislamiento de objetos auditivos del ruido de fondo, y con el reconocimiento de palabras habladas, voces, melodías, sonidos ambientales y sonidos comunicativos no hablados. Un meta-análisis de estudios de IRMf demostró además la disociación funcional entre el mSTG izquierdo y el aSTG, con el primero procesando unidades cortas del habla (fonemas) y el segundo procesando unidades más largas (por ejemplo, palabras, sonidos ambientales). Un estudio que registró la actividad neural directamente del pSTG y el aSTG izquierdos informó de que el aSTG, pero no el pSTG, estaba más activo cuando la paciente escuchaba el habla en su lengua materna que en una lengua extranjera desconocida. De forma consistente, la electroestimulación en el aSTG de esta paciente dio lugar a un deterioro de la percepción del habla (ver también resultados similares). Las grabaciones intracorticales del aSTG derecho e izquierdo demostraron además que el habla se procesa lateralmente a la música. Un estudio de IRMf de un paciente con deterioro en el reconocimiento de sonidos (agnosia auditiva) debido a un daño en el tronco cerebral también mostró una activación reducida en las áreas hR y aSTG de ambos hemisferios al escuchar palabras habladas y sonidos ambientales. Las grabaciones del córtex auditivo anterior de los monos mientras mantienen los sonidos aprendidos en la memoria de trabajo, y el efecto debilitador de las lesiones inducidas en esta región sobre el recuerdo de la memoria de trabajo, implican aún más al SVA en el mantenimiento de los objetos auditivos percibidos en la memoria de trabajo. En los seres humanos, el área mSTG-aSTG también se activó durante el ensayo de sílabas escuchadas con MEG y fMRI. Este último estudio demostró además que la memoria de trabajo en el AVS es para las propiedades acústicas de las palabras habladas y que es independiente de la memoria de trabajo en el ADS, que media el habla interna. Los estudios sobre la memoria de trabajo en monos también sugieren que, a diferencia de los humanos, el AVS es el almacén dominante de la memoria de trabajo.

En los humanos, después del aSTG, se cree que el MTG y el TP constituyen el léxico semántico, que es un depósito de memoria a largo plazo de representaciones audiovisuales que están interconectadas sobre la base de relaciones semánticas. (Véanse también las revisiones en las que se trata este tema). La principal prueba de esta función del MTG-TP es que los pacientes con daños en esta región (por ejemplo, pacientes con demencia semántica o encefalitis por el virus del herpes simple) presentan una capacidad deteriorada para describir objetos visuales y auditivos y una tendencia a cometer errores semánticos al nombrar objetos (es decir, parafasia semántica). Las parafasias semánticas también fueron expresadas por pacientes afásicos con daño en el MTG-TP izquierdo y se demostró que ocurren en pacientes no afásicos después de la electroestimulación de esta región. o la vía de materia blanca subyacente Dos meta-análisis de la literatura de fMRI también informaron que el MTG anterior y el TP fueron consistentemente activos durante el análisis semántico del habla y el texto; y un estudio de registro intra-cortical correlacionó la descarga neural en el MTG con la comprensión de frases inteligibles.

Comprensión de oracionesEditar

Además de extraer el significado de los sonidos, la región MTG-TP del SVA parece tener un papel en la comprensión de oraciones, posiblemente fusionando conceptos (por ejemplo, fusionando los conceptos «azul» y «camisa» para crear el concepto de «camisa azul»). El papel del MTG en la extracción del significado de las oraciones se ha demostrado en estudios de imágenes funcionales que informan de una mayor activación en el MTG anterior cuando se contrastan oraciones propias con listas de palabras, oraciones en un idioma extranjero o sin sentido, oraciones revueltas, oraciones con violaciones semánticas o sintácticas y secuencias de sonidos ambientales similares a oraciones. Un estudio de IRMf en el que se indicó a los participantes que leyeran una historia correlacionó además la actividad en el MTG anterior con la cantidad de contenido semántico y sintáctico de cada frase. Un estudio de EEG que contrastó la actividad cortical durante la lectura de frases con y sin violaciones sintácticas en participantes sanos y en pacientes con daños en el MTG-TP, concluyó que el MTG-TP de ambos hemisferios participa en la etapa automática (basada en reglas) del análisis sintáctico (componente ELAN), y que el MTG-TP izquierdo también participa en una etapa posterior controlada del análisis sintáctico (componente P600). Los pacientes con daños en la región del MTG-TP también se han visto afectados por la comprensión de frases. Véase la revisión para obtener más información sobre este tema.

BilateralidadEditar

En contradicción con el modelo de Wernicke-Lichtheim-Geschwind que implica que el reconocimiento del sonido se produce únicamente en el hemisferio izquierdo, los estudios que examinaron las propiedades del hemisferio derecho o izquierdo de forma aislada mediante anestesia hemisférica unilateral (es decir, el procedimiento WADA) o grabaciones intracorticales de cada hemisferio proporcionaron pruebas de que el reconocimiento del sonido se procesa de forma bilateral. Además, un estudio en el que se instruyó a pacientes con hemisferios desconectados (es decir, pacientes con cerebro dividido) para que emparejaran palabras habladas con palabras escritas presentadas en los hemisferios derecho o izquierdo, informó de un vocabulario en el hemisferio derecho que casi coincide en tamaño con el del hemisferio izquierdo (el vocabulario del hemisferio derecho era equivalente al de un niño sano de 11 años). Este reconocimiento bilateral de los sonidos también es coherente con el hallazgo de que la lesión unilateral de la corteza auditiva rara vez da lugar a un déficit de comprensión auditiva (es decir, agnosia auditiva), mientras que una segunda lesión en el hemisferio restante (que podría producirse años después) sí lo hace. Por último, como se ha mencionado anteriormente, un escáner de IRMf de un paciente con agnosia auditiva demostró una activación bilateral reducida en las cortezas auditivas anteriores, y la electroestimulación bilateral de estas regiones en ambos hemisferios dio lugar a un deterioro del reconocimiento del habla.

Corriente dorsal auditivaEditar

La corriente dorsal auditiva conecta la corteza auditiva con el lóbulo parietal, que a su vez conecta con la circunvolución frontal inferior. Tanto en los seres humanos como en los primates no humanos, la corriente dorsal auditiva es responsable de la localización del sonido y, por lo tanto, se conoce como la vía auditiva del «dónde». En los seres humanos, esta vía (especialmente en el hemisferio izquierdo) también es responsable de la producción del habla, la repetición del habla, la lectura de los labios y la memoria de trabajo fonológica y la memoria a largo plazo.

Producción del hablaEditar

Los estudios de los seres humanos actuales han demostrado un papel para el ADS en la producción del habla, en particular en la expresión vocal de los nombres de los objetos. Por ejemplo, en una serie de estudios en los que se estimularon directamente las fibras subcorticales, la interferencia en el pSTG y el IPL izquierdos provocó errores durante las tareas de denominación de objetos, y la interferencia en el IFG izquierdo provocó la detención del habla. La interferencia magnética en el pSTG y el IFG de participantes sanos también produjo errores y detención del habla, respectivamente Un estudio también ha informado de que la estimulación eléctrica del IPL izquierdo hizo que los pacientes creyeran que habían hablado cuando no lo habían hecho y que la estimulación del IFG hizo que los pacientes movieran los labios inconscientemente. La contribución del ADS al proceso de articulación de los nombres de los objetos podría depender de la recepción de aferentes del léxico semántico del SVA, ya que un estudio de registro intracortical informó de la activación en el MTG posterior antes de la activación en la región Spt-IPL cuando los pacientes nombraban objetos en imágenes Los estudios de estimulación eléctrica intracortical también informaron de que la interferencia eléctrica en el MTG posterior se correlacionaba con el deterioro de la nomenclatura de objetos

Imitación vocalEditar

Aunque la percepción del sonido se atribuye principalmente al SVA, el ADS parece estar asociado con varios aspectos de la percepción del habla. Por ejemplo, en un meta-análisis de estudios de fMRI (Turkeltaub y Coslett, 2010), en el que la percepción auditiva de los fonemas se contrastó con sonidos muy parecidos, y los estudios se clasificaron según el nivel de atención requerido, los autores concluyeron que la atención a los fonemas se correlaciona con una fuerte activación en la región pSTG-pSTS. Un estudio de registro intracortical en el que se indicó a los participantes que identificaran sílabas también correlacionó la audición de cada sílaba con su propio patrón de activación en el pSTG. La implicación del ADS tanto en la percepción como en la producción del habla se ha puesto de manifiesto en varios estudios pioneros de imagen funcional que contrastan la percepción del habla con la producción del habla abierta o encubierta. Estos estudios demostraron que el pSTS sólo está activo durante la percepción del habla, mientras que el área Spt está activa tanto en la percepción como en la producción del habla. Los autores concluyeron que el pSTS se proyecta al área Spt, que convierte la entrada auditiva en movimientos articulatorios. Se obtuvieron resultados similares en un estudio en el que se estimularon eléctricamente los lóbulos temporal y parietal de los participantes. Este estudio informó de que la estimulación eléctrica de la región pSTG interfiere con la comprensión de frases y que la estimulación del IPL interfiere con la capacidad de vocalizar los nombres de los objetos. Los autores también informaron de que la estimulación en el área Spt y la LPI inferior indujo interferencias durante las tareas de denominación de objetos y de comprensión del habla. El papel del ADS en la repetición del habla también es congruente con los resultados de otros estudios de imagen funcional que han localizado la activación durante las tareas de repetición del habla en regiones del ADS. Un estudio de registro intracortical que registró la actividad en la mayor parte de los lóbulos temporal, parietal y frontal también informó de la activación en el pSTG, Spt, IPL e IFG cuando la repetición del habla se contrasta con la percepción del habla. Los estudios neuropsicológicos también han encontrado que los individuos con déficits de repetición del habla pero con comprensión auditiva preservada (es decir, afasia de conducción) sufren un daño circunscrito en el área Spt-IPL o un daño en las proyecciones que emanan de esta área y se dirigen al lóbulo frontal Los estudios también han informado de un déficit transitorio de repetición del habla en pacientes después de la estimulación eléctrica intracortical directa en esta misma región. Los estudios longitudinales de niños que correlacionan el aprendizaje de vocabulario extranjero con la capacidad de repetir palabras sin sentido proporcionan información sobre el propósito de la repetición del habla en el ADS.

Monitorización del hablaEditar

Además de repetir y producir el habla, el ADS parece tener un papel en la monitorización de la calidad de la salida del habla. Las pruebas neuroanatómicas sugieren que el ADS está dotado de conexiones descendentes desde el IFG hasta el pSTG que transmiten información sobre la actividad motora (es decir, descargas corolarias) en el aparato vocal (boca, lengua, pliegues vocales). Esta retroalimentación marca el sonido percibido durante la producción del habla como autoproducido y puede utilizarse para ajustar el aparato vocal para aumentar la similitud entre las llamadas percibidas y emitidas. Un estudio que estimuló eléctricamente el IFG durante una operación quirúrgica e informó de la propagación de la activación a la región pSTG-pSTS-Spt ofrece pruebas de la existencia de conexiones descendentes desde el IFG hasta el pSTG, Un estudio que comparó la capacidad de los pacientes afásicos con daño en el lóbulo frontal, parietal o temporal para articular rápida y repetidamente una cadena de sílabas informó que el daño en el lóbulo frontal interfería con la articulación tanto de cadenas silábicas idénticas («Bababa») como de cadenas silábicas no idénticas («Badaga»), mientras que los pacientes con daño en el lóbulo temporal o parietal sólo mostraban deterioro al articular cadenas silábicas no idénticas. Dado que los pacientes con daños en los lóbulos temporales y parietales fueron capaces de repetir la cadena silábica en la primera tarea, su percepción y producción del habla parece estar relativamente preservada, y su déficit en la segunda tarea se debe, por tanto, a un deterioro de la monitorización. Demostrando el papel de las conexiones descendentes del ADS en la monitorización de las llamadas emitidas, un estudio de IRMf instruyó a los participantes para que hablaran en condiciones normales o al escuchar una versión modificada de su propia voz (primer formante retardado) e informó de que escuchar una versión distorsionada de la propia voz resulta en una mayor activación en el pSTG. Una demostración más de que el ADS facilita la retroalimentación motora durante la imitación es un estudio de registro intracortical que contrastó la percepción y la repetición del habla. Los autores informaron de que, además de la activación en el IPL y el IFG, la repetición del habla se caracteriza por una mayor activación en el pSTG que durante la percepción del habla.

Integración de los fonemas con los movimientos de los labiosEditar

Aunque la percepción del sonido se atribuye principalmente al AVS, el ADS parece estar asociado a varios aspectos de la percepción del habla. Por ejemplo, en un meta-análisis de estudios de fMRI en los que se contrastó la percepción auditiva de fonemas con sonidos estrechamente coincidentes, y los estudios fueron calificados por el nivel de atención requerido, los autores concluyeron que la atención a los fonemas se correlaciona con una fuerte activación en la región pSTG-pSTS. Un estudio de registro intracortical en el que se instruyó a los participantes a identificar sílabas también correlacionó la audición de cada sílaba con su propio patrón de activación en el pSTG. En consonancia con el papel del ADS en la discriminación de los fonemas, los estudios han atribuido la integración de los fonemas y sus correspondientes movimientos labiales (es decir, los visemas) al pSTS del ADS. Por ejemplo, un estudio de resonancia magnética funcional ha correlacionado la activación del STP con la ilusión de McGurk (en la que al oír la sílaba «ba» y ver el visema «ga» se percibe la sílaba «da»). Otro estudio ha descubierto que el uso de la estimulación magnética para interferir con el procesamiento en esta área interrumpe aún más la ilusión de McGurk. La asociación del PSTS con la integración audiovisual del habla también se ha demostrado en un estudio que presentaba a los participantes imágenes de caras y palabras habladas de distinta calidad. El estudio informó de que el pSTS selecciona el aumento combinado de la claridad de las caras y las palabras habladas. Un estudio de fMRI que contrastó la percepción del habla audiovisual con la del no habla audiovisual (imágenes y sonidos de herramientas) ha aportado pruebas que lo corroboran. Este estudio informó de la detección de compartimentos selectivos del habla en el PSTS. Además, un estudio de RMNf que contrastó el habla audiovisual congruente con el habla incongruente (imágenes de rostros inmóviles) informó de la activación del TSPA. Para una revisión que presenta evidencia adicional convergente con respecto al papel del pSTS y ADS en la integración fonema-visema ver.

Memoria fonológica a largo plazoEditar

Un creciente cuerpo de evidencia indica que los seres humanos, además de tener un almacén a largo plazo para los significados de las palabras ubicadas en el MTG-TP de la AVS (es decir, el léxico semántico), también tienen un almacén a largo plazo para los nombres de los objetos situados en la región Spt-IPL del ADS (es decir, el léxico fonológico). Por ejemplo, un estudio que examinó a pacientes con daños en el SVA (daño en el MTG) o en el ADS (daño en el IPL) informó de que el daño en el MTG hace que los individuos identifiquen incorrectamente los objetos (por ejemplo, llamando a una «cabra» una «oveja», un ejemplo de parafasia semántica). Por el contrario, los daños en el LPI hacen que los individuos identifiquen correctamente el objeto pero pronuncien incorrectamente su nombre (por ejemplo, diciendo «gof» en lugar de «cabra», un ejemplo de parafasia fonética). También se ha informado de errores de parafasia semántica en pacientes que reciben estimulación eléctrica intracortical del SVA (MTG), y de errores de parafasia fonémica en pacientes cuyo SDA (pSTG, Spt e IPL) recibió estimulación eléctrica intracortical. Un estudio de MEG que localizó la actividad en el IPL durante el aprendizaje y el recuerdo de los nombres de los objetos apoya el papel del ADS en la denominación de objetos. Un estudio que indujo la interferencia magnética en el LPI de los participantes mientras respondían a preguntas sobre un objeto informó de que los participantes eran capaces de responder a preguntas relativas a las características del objeto o a los atributos perceptivos, pero que se veían perjudicados cuando se les preguntaba si la palabra contenía dos o tres sílabas. Un estudio de MEG también ha correlacionado la recuperación de la anomia (un trastorno caracterizado por la incapacidad de nombrar objetos) con cambios en la activación del LPI. Los estudios que informan de que, en comparación con los monolingües, los bilingües tienen una mayor densidad cortical en la LPI, pero no en el MTG, respaldan el papel de la LPI en la codificación de los sonidos de las palabras. Dado que la evidencia muestra que, en los bilingües, diferentes representaciones fonológicas de la misma palabra comparten la misma representación semántica, este aumento de la densidad en la LPI verifica la existencia del léxico fonológico: se espera que el léxico semántico de los bilingües tenga un tamaño similar al léxico semántico de los monolingües, mientras que su léxico fonológico debería ser el doble de grande. En consonancia con este hallazgo, la densidad cortical en la LPI de los monolingües también se correlaciona con el tamaño del vocabulario. En particular, la disociación funcional del AVS y el ADS en las tareas de nombramiento de objetos está respaldada por la evidencia acumulada de la investigación de la lectura que muestra que los errores semánticos están correlacionados con el deterioro del MTG y los errores fonémicos con el deterioro del IPL. Sobre la base de estas asociaciones, el análisis semántico del texto se ha vinculado a la circunvolución inferior-temporal y al MTG, y el análisis fonológico del texto se ha vinculado al pSTG-Spt- IPL

Memoria de trabajo fonológicaEditar

La memoria de trabajo suele tratarse como la activación temporal de las representaciones almacenadas en la memoria a largo plazo que se utilizan para el habla (representaciones fonológicas). Esta compartición de recursos entre la memoria de trabajo y el habla es evidente por el hallazgo de que hablar durante el ensayo resulta en una reducción significativa del número de elementos que pueden ser recordados desde la memoria de trabajo (supresión articulatoria). La implicación del léxico fonológico en la memoria de trabajo también se pone de manifiesto en la tendencia de los individuos a cometer más errores cuando recuerdan palabras de una lista de palabras fonológicamente similares recientemente aprendidas que de una lista de palabras fonológicamente disímiles (efecto de similitud fonológica). Los estudios también han descubierto que los errores de habla cometidos durante la lectura son notablemente similares a los errores de habla cometidos durante el recuerdo de palabras fonológicamente similares recientemente aprendidas de la memoria de trabajo. Por último, la opinión de que la memoria de trabajo verbal es el resultado de la activación temporal de las representaciones fonológicas en el ADS es compatible con los modelos recientes que describen la memoria de trabajo como la combinación del mantenimiento de las representaciones en el mecanismo de atención en paralelo a la activación temporal de las representaciones en la memoria a largo plazo. Se ha argumentado que el papel del ADS en el ensayo de listas de palabras es la razón por la que esta vía está activa durante la comprensión de oraciones Para una revisión del papel del ADS en la memoria de trabajo, véase.